概要

超教育協会は6月28日、東京大学大学院工学系研究科 附属国際工学教育推進機構 准教授の吉田 塁氏を招いて、「ChatGPTが教育に与える影響」と題したオンラインシンポジウムを開催した。

シンポジウムの前半では、吉田氏がChatGPTをはじめとする生成AIの現状や教育での活用について講演し、後半では、超教育協会理事長の石戸 奈々子をファシリテーターに、視聴者からの質問を織り交ぜながら質疑応答が実施された。その前半の模様を紹介する。

>> 後半のレポートはこちら

>> シンポジウム動画も公開中!Youtube動画

「ChatGPTが教育に与える影響」

■日時:2023年6月28日12時~12時55分

■講演:吉田 塁氏

東京大学大学院工学系研究科 附属国際工学教育推進機構 准教授

■ファシリテーター:石戸 奈々子

超教育協会理事長

吉田氏は、約30分の講演において、ChatGPTの現状と教育に与える影響について話した。主な講演内容は以下の通り。

ChatGPTが教育に与える影響を考察する前に、生成AIについて説明します。生成AIという言葉はかなり浸透してきてはいますが、実は生成AIについて世界共通の明確な定義はありません。ただ大枠の合意として説明はされています。例えば、学習データをもとにテキストや画像などのコンテンツを生成できる人工知能と説明できます。

▲ スライド1・生成AIの定義

▲ スライド1・生成AIの定義

コンテンツを生成できる人工知能ということがポイントになっていて、コンテンツは必ずしもテキストでなくてもよいということです。有名なところでは画像生成も去年から話題になっています。音声生成もあれば、最近だとVR空間で使えるような3次元のオブジェクトを生成するAIも登場しています。テキスト生成系ではChatGPTのみならず、ClaudeやBardやLLaMAなどさまざまな言語モデルがあります。その中でもテキスト生成系のAIが教育にさまざまな影響を与えると考えられることから、その代表例であるChatGPTについて説明します。

GPT-3.5ではできないこともGPT-4では可能に 性能に大きな違いがある

ChatGPTとは対話できるAIで、2022年の11月30日に公開されました。ユーザー数の伸びが非常に速く、5日で100万人、2カ月で1億人が使っています。2023年1月時点でスタンフォード大学の学生の17%が試験に使っているという状況でした。多くの学生はアイデア出しなどでChatGPTを使っていましたが、割合は少ないものの、ChatGPTが出力した内容をそのままレポートなど、試験の回答として提出している学生もいました。選択式の問題をChatGPTに答えてもらうといった使い方をしている学生もいました。

最近の日本の調査でも、利用が広がっていることが分かっていて、多くの学生は自分のアイデアをブラッシュアップする相談相手として使っています。現時点ではある程度、健全に使われているようです。2023年3月から高性能のGPT-4が出ています。もともとChatGPTは、大規模言語モデルのGPT(Generative Pre-trained Transformer)というものをベースに、人との対話に特化させるように学習させたものです。もともとは、GPT-3.5をベースにChatGPTが作られていました。3月からはGPT-4が有料プランで使用可能になりました。これはかなり性能が高く、3.5と4では大きな違いがあることを認識していただきたいと思います。

ChatGPTは使うことが簡単です。まずアカウントを作ってサインインします。

▲ スライド2・ChatGPTの画面(有料版)

▲ スライド2・ChatGPTの画面(有料版)

画面のメッセージ欄に「こんにちは」と打つと、出力が返ってきて対話ができます。入力するテキストのことをプロンプトと言います。プロンプトを入力するうえでの心得をまず伝えておきます。お勧めの方法は、こういうものを出力してもらいたいというイメージを明確にして、ChatGPTにそれを伝えるというやり方です。例えば表形式で出力してくださいと言えば表形式で出力してくれますし、これとこれを列にしてくださいとお願いすれば、それに沿って出力してくれるため、思い通りの出力にならなかったとしても、まず対話して進めていくことが大切です。

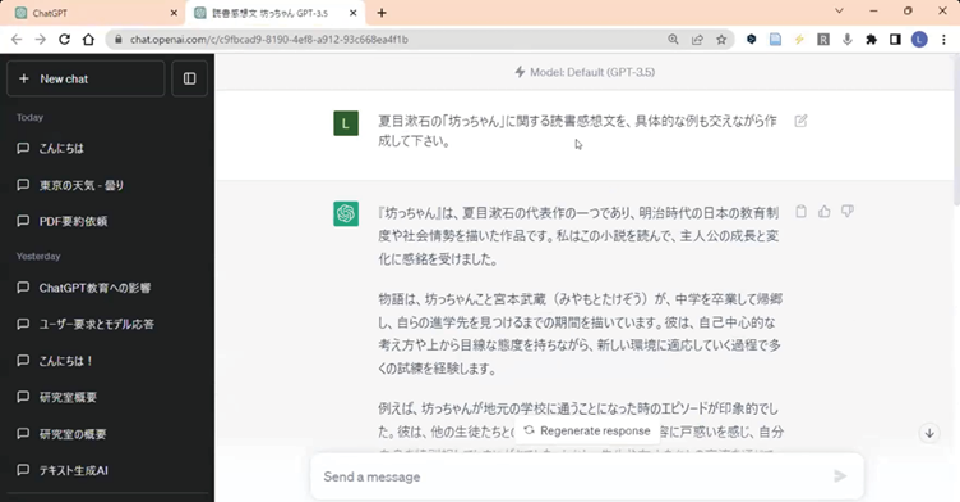

次にChatGPTで何ができるのかを説明します。基本的に言語に関連するタスクであれば何でも出力してくれます。ただ、クオリティは分野や専門によってまちまちです。例えば簡単な掛け算を間違えることもありますが、一方で司法試験を解けるような性能も持っています。さまざまなことができ、読書感想文を作成したりレポート作成したりすることも可能です。

例えば「ChatGPTに夏目漱石の『坊っちゃん』に関する読書感想文を具体的な例も交えながら作成してください」と入れると、書いてくれます。

▲ スライド3・ChatGPTが出力した

▲ スライド3・ChatGPTが出力した

「坊ちゃん」の感想文

その中で、「物語は坊っちゃんこと宮本武蔵(みやもとたけぞう)が中学を卒業して帰郷し、自らの進学先を見つけるまでの期間を描いています」という表記がありますが、これは嘘です。このようにChatGPTは「でたらめ」を言います。一見すると正しいと思えてしまうような文章を出力しますが、誤りを含むことが多いので、その点では注意が必要でしょう。そうしたことを踏まえても、かなりナチュラルな日本語を出力してくれます。その点で驚くべき技術です。

レポートの作成についても、現時点では「できなくはない」というところだと思います。私は学生に「新たな意義あるEdTechの提案」という課題を出しました。この課題の文言をChatGPTにそのまま入力して答えてもらうと、すらすらと書いてはくれます。GPT-3.5だと、まず、教育の課題を特定して、その上でこういうEdTechを提案すると書いてくれます。自分なりに修正すれば、レポートの形にはなるものになっています。ある程度レポートのような出力はしてくれますが、単純に出力されたものをそのままレポートして使えるかというと、そうではないのがGPT-3.5の実情です。

それがGPT-4になると、こちらが指示出しする内容の文脈や意図を把握する能力がかなり高くなっています。レポートとしてそのままコピペして出せるレベルのものを出してくれると思います。ただ実際の出力を見ると、「AIを搭載した個別学習支援システムを提案します」とありきたりで、正直、面白くない内容を出してきます。

文章としてはある程度成立しているので、これが及第点になってしまう確率もゼロではありませんが、例えば実際に個別学習システムにAIを搭載するといっても、どのようなデータを使ってどのようなアルゴリズムを用いて学習を支援するのかがキーになります。そこでより深掘りした質問をすると、それに対する答えも返してくれるので、レポートをブラッシュアップするサポーターとしても機能するという印象を持っています。その意味では、単なる学習成果物を生成するものという位置づけではなく、学習をサポートする側面も持っているのがChatGPTだと考えています。また、選択式の問題にも回答することができます。多肢選択の問題で、GPT-3.5では不正解でもGPT-4では正解できる場合が多いです。GPT-3.5だけを使ってこの程度かと思うのではなくて、GPT-4でも同様のことが起きるのか確認したほうがChatGPTの正しい理解につながるでしょう。

レポートなどを「書いてくれる」のではなく学習プロセスを支援してくれるChatGPT

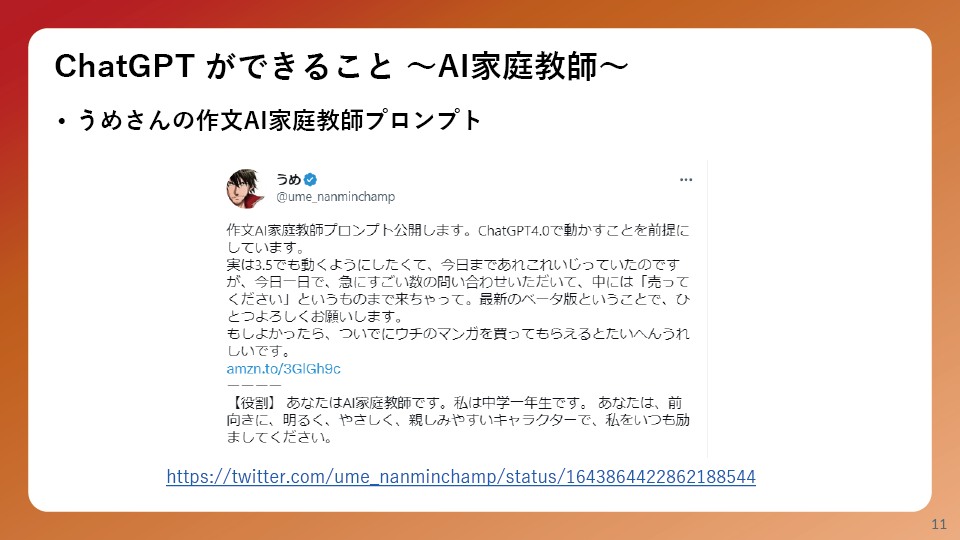

ChatGPTが持つ、学習をサポートする側面について説明します。ChatGPTは、学習プロセスを支援することにも使えます。ここでは「うめさん」というハンドルネームの投稿者が、娘さんの作文のためにChatGPTに家庭教師になってもらい、学習プロセスを支援してもらったという事例を紹介します。

▲ スライド4・AI家庭教師として

▲ スライド4・AI家庭教師として

学習プロセスを支援することも可能

家庭教師であるChatGPTにどのようなお願いをしていったのか、プロンプトを紹介すると、「あなたはAI家庭教師です。親しみやすいキャラクターで私をいつも励ましてください」などと入力しています。普通のプロンプトより長めのものになっています。するとChatGPTが「どんなテーマで作文を書きますか」と聞いてくれるので、娘さんが「小学校生活で一番心に残った思い出についてです」と入力します。するとそれに対して「具体的にどんな出来事ですか」とChatGPTが聞いてきたので、「色々あってわからないです」と答えます。それに対して「大丈夫です。一つずつ考えていきましょう。何か特に印象に残っていることはありますか」、「6年生の音楽会です」というように対話が続いていきます。

対話を続けて最終的には、娘さんが作文を書ける状態になります。作文自体は生成せずに終わりますが、作文作成のプロセスを支援してくれます。こういったこともChatGPTは実現できるのです。これは、学習プロセスを支援するという観点で分かりやすい事例なので紹介しました。

学習者が作るべきコンテンツ、つまり読書感想文やレポートなどを自動生成してしまう側面ももちろんありますが、学習プロセスを支援してくれる側面もあるということは重要です。また、教員を支援してくれることもあって、選択式の問題を作成してくれるし、場合によっては回答を作ってください、解説を作ってくださいと入力すると、それらを作ってくれます。教員の負荷が減ってよりよい授業づくりにリソースを割くことができます。そういった意味でプラスの面が多いと私は考えています。

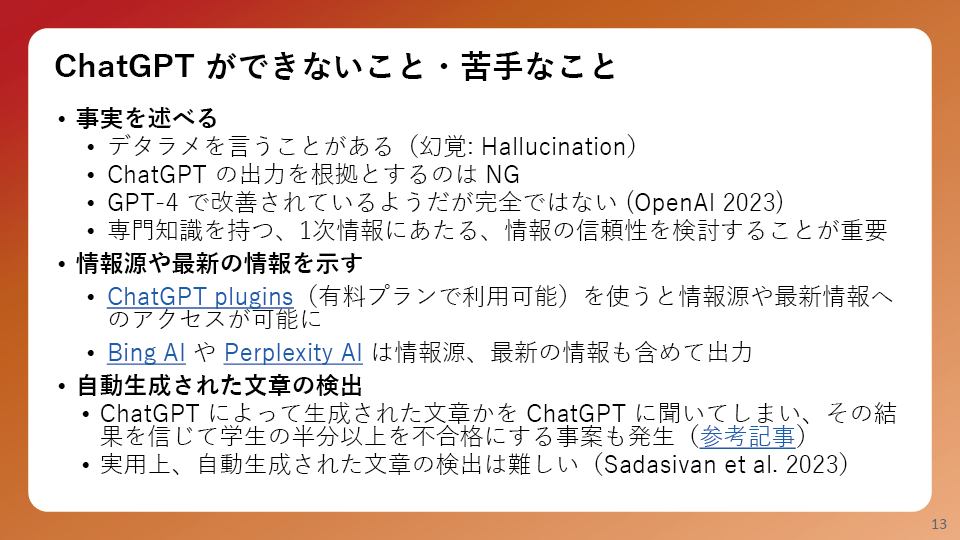

「事実を述べること」や「自動生成された文書を検出すること」が苦手

ただし、ここで注意していただきたいのがChatGPTにはできないこと、苦手なことがあるということです。

▲ スライド5・ChatGPTが

▲ スライド5・ChatGPTが

できないこと・苦手なこと

まず教育における活用ということで最初にお伝えしておくと、事実を述べることが苦手でなかなかできません。言い方を変えると「でたらめを言うことがある」ということです。これは「幻覚」や「Hallucination」と言われていますが、先ほどの「坊っちゃん」の例でもあったように、でたらめを言うことがあります。なので、「ChatGPTがこう言っていたから」という使い方は問題があります。GPT-4でも、事実を述べることに関しては改善の余地があると言われています。活用するには専門的な知識を持つなど、出力された情報が正しいのか検証する姿勢が必要となるでしょう。無料バージョンのChatGPTだと情報源を出すことはできません。ただ、ChatGPTのブラウジングとかプラグインの機能を使うと情報源や最新の情報にアクセスできます。

また海外では、ChatGPTによって生成された文章かをChatGPTに聞いてしまい、その結果を信じて学生の半分以上を不合格にする事案も発生しています。実はChatGPTには自動生成された文章を検出する機能はないため、そういった使い方はできないのです。また、実用上、自動生成された文章かどうかを検出することは難しいといわれています。特に問題なのは誤検出です。私も実際に試しましたが、私が書いたオリジナルの文章でも、この文章はAIによって書かれたという判断をされてしまうことがあります。完全な検出方法は現時点では存在しません。自動生成された文章を検出できないというスタンスで考えていくことが重要です。

ChatGPTの中核をなす大規模言語モデルはパラメータが一定数を超えると「創発性」を発揮する

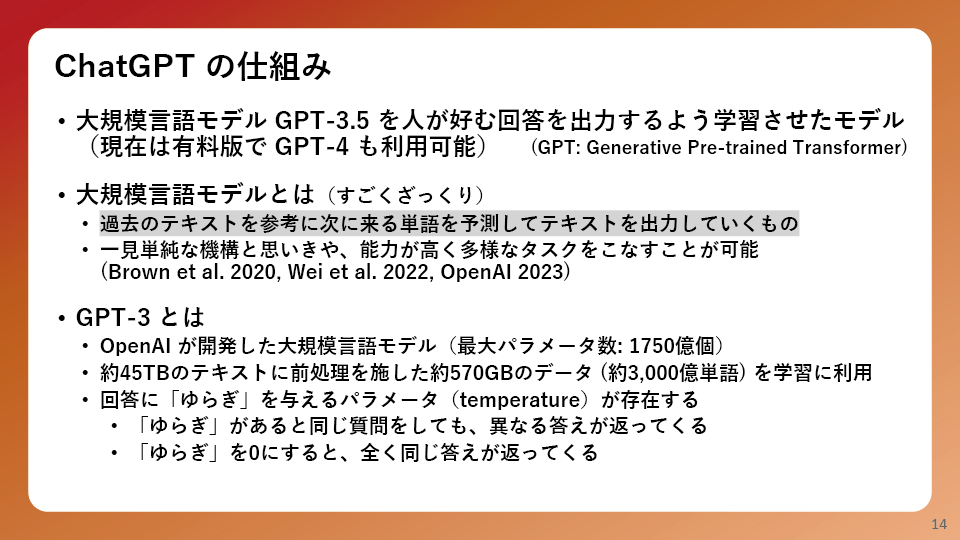

次にChatGPTの仕組みを説明します。ChatGPTは大規模言語モデルGPT-3.5ベースにして人が好む回答を出力させるように学習させたモデルです。

▲ スライド6・ChatGPTの仕組み

▲ スライド6・ChatGPTの仕組み

大規模言語モデルとは、ざっくり説明すると、過去のテキストを参考に次にくる単語を予測してテキストを出力していくものです。次の単語を予想することに特化したモデルといえるでしょう。一見すると単純な機構と思いきや、能力が高く多様なタスクをこなすことが可能です。言語モデルにはパラメータというものが存在していて、パラメータの数がどんどん変わってきました。ポイントは、あるパラメータ数を超えると急に性能が上がると言われていることです。AIの研究者も、それについては驚きを隠せなかったと言います。

具体的には1,000億パラメータを超えるあたりで急に性能が上がります。人間と対話しているような自然なやり取りは、この創発的な能力を言語モデルが獲得したからできたのではないかといわれています。ただ最近は、13億パラメータでも学習データを工夫することによってかなり能力が高くなるともされています。正確な理由などはまだ明らかになっていないのですが、実際にモデルを改良していくと、ある閾値から急に様々なことができるようになったという現象が起こっています。単純に次の単語を予想するというものではありますが、単純な機構でできるとは思えないようなことまでできるようになっているのがポイントでもあります。

GPT-4とGPT-3.5の違いについて改めて詳細をお伝えすると、例えばアメリカの司法試験において、GPT-3.5では下位10%のスコアだったものが、GPT-4だと上位10%のスコアになるほど成績が上がっています。また、GPT-4はマイナーな言語についても扱えます。GPT-3.5に英語で聞くよりも、GPT-4に日本語で聞いたほうが正しく回答を得られるケースがあることもわかっています。実際に私も使っていて、GPT-3.5に日本語で聞くとあまりよくない回答が返ってきますが、GPT-4になると日本語でも筋の良い回答が返ってくるという印象を持っています。GPT-3.5とGPT-4には大きな差があると思ってもらってよいでしょう。GPT-4とGPT-3.5の性能差が大きいので、学習機会の格差にもつながりうると思います。GPT-4を無料で使う方法として、ひとつの選択肢はMicrosoftが提供しているBingAIを使うことです。ただしChatGPTのGPT-4とは若干の性能差があるような印象です。

生成系AIはcopilot(副操縦士) メインのパイロットは人間

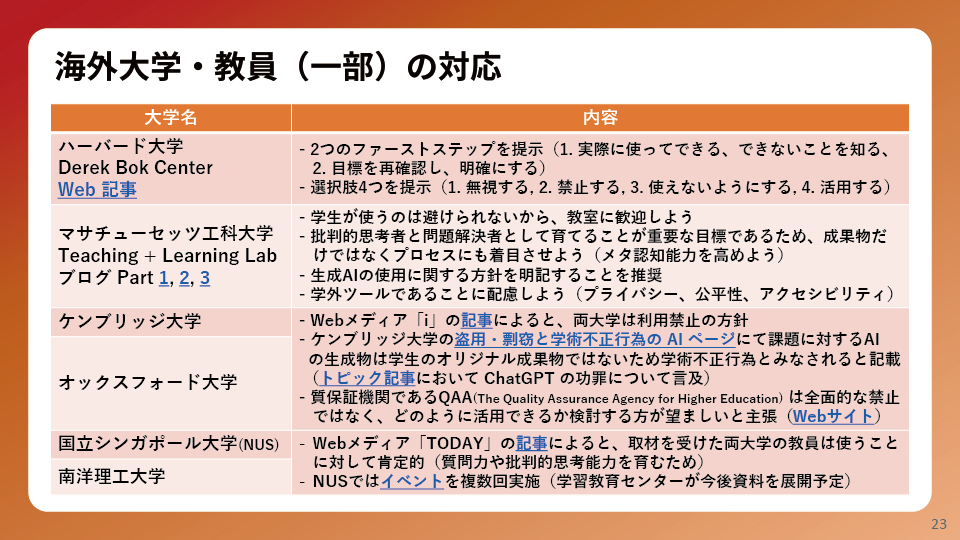

ChatGPTが教育にどういうインパクトを与えるかについて、簡単に国内外の動向を紹介します。

▲ スライド7・ChatGPTに対する海外大学の対応

▲ スライド7・ChatGPTに対する海外大学の対応

基本的にアメリカの大学は禁止する方針ではありません。イギリスに関しては、当初は全面的な禁止の色合いが強かったようです。ケンブリッジ大学ではウェブサイト上では使用禁止としています。一方、イギリスの高等教育の質保証機構であるQAAでは、全面的な禁止ではなく、どのように活用できるか検討する方が望ましいと主張しています。今後、生成AIが社会に入り込んでくることを考えると、おそらくイギリスも全面的な禁止という方針ではなくなると思います。シンガポールは積極的に使っているという印象です。

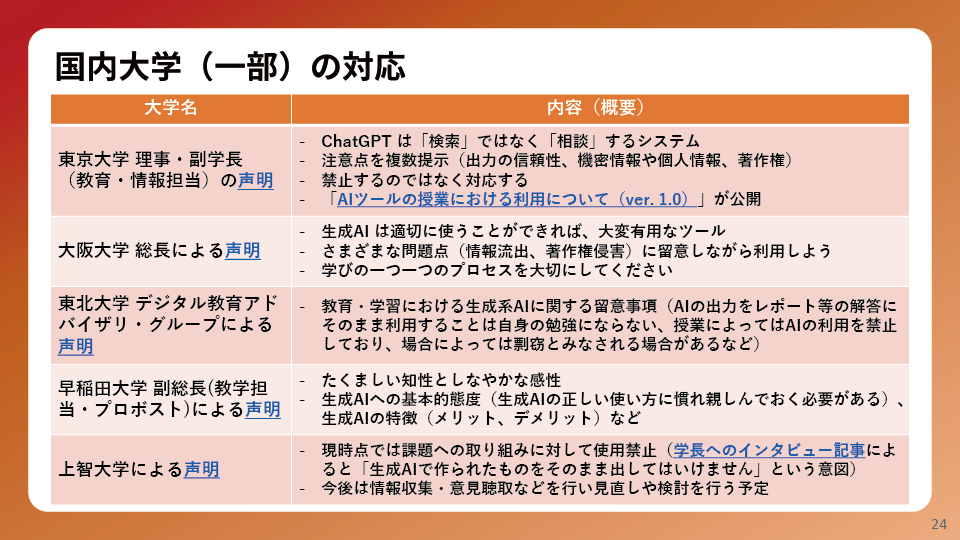

国内大学でも、全面的に禁止と言っているところは現状ではありません。

▲ スライド8・ChatGPTに対する国内大学の対応

▲ スライド8・ChatGPTに対する国内大学の対応

当初、上智大学は文言から全面的に禁止と思われていましたが、学長へのインタビュー記事によると、生成AIで作られたものをそのまま出してはいけないということで、全面的な禁止ではないようです。そのままコピペして出すのは禁止だけれど、それを編集加工することに関しては特に禁止しないという主旨のコメントを出しています。国内大学も全面的な禁止というよりも、リスクに注意しながら使っていくというスタンスになっています。

ChatGPTの影響のひとつとして、評価を揺るがす可能性があります。わかりやすい例を示すと、筆記関係の評価方法に影響を与えると考えられます。ChatGPT自体が選択式の問題の回答もできれば、自由記述の回答もできます。小論文やレポートの作成もできるので、こういった筆記に関係するような評価方法には大きなインパクトを与えるだろうと考えています。

ChatGPTを使わせない評価方法にするとか、逆にChatGPTを積極的に使わせることも考えられると思っています。私としては、本質的に「ChatGPTでラクをしたい」と思われるような授業ではなく、自分で学びたい、自分で課題に取り組みたいと思ってもらえるような授業づくりが重要だと思います。

使わせない方法はいくつか考えられて、まず重要なのは使用禁止のポリシーを明確に伝えることです。具体的にどの場面で使ってはいけないのかというポリシーを決めます。そのうえで具体的な方策としては物理的に禁じる、自動生成しにくいものを課題にする、などが考えられます。対面でレポートを書かせる、プレゼンテーションや口頭試問にするなども考えられるでしょう。成果物を自動生成しにくい課題にするということでは、マルチメディアに弱いため、概念マップなど図の作成を取り入れるなどが考えられます。

一方、ChatGPTを積極的に使わせることも進んでいて、例えばYale大学では、ChatGPTを使った最終論文を作成するオプションを大学院生に提供しています。自分の現在の研究に関連するトピックを選びChatGPTにドラフトを書かせて、それを学生が編集したうえでAIのオリジナル原稿と最終版を提出するという方法で積極的に使わせています。

また、先ほどのうめさんのAI家庭教師の例でもあるように、ChatGPTは個別チューターになりえます。世界最大級のオンライン学習プラットフォームでKahn Academyというものがあるのですが、すでに去年の8月からOpenAIと組んで個別チューターの開発をしています。答えは返してくれないけれど、思考をサポートするようなチューターを作っています。今後、こういったものはどんどん広まっていくでしょう。

さらに、教員の授業づくりも支援できるものと思っていて、シラバス作成やワークの設計なども可能でしょう。例えばアクティブラーニングを導入したいという教員がいた場合、特にGPT-4はアクティブラーニングの方法に関する知識も持っているため、それに関する質問をするとかなり的確に返してくれますし、建設的なアドバイスもしてくれます。そういった意味では、教員のお供としても使えるような技術になっていると感じています。

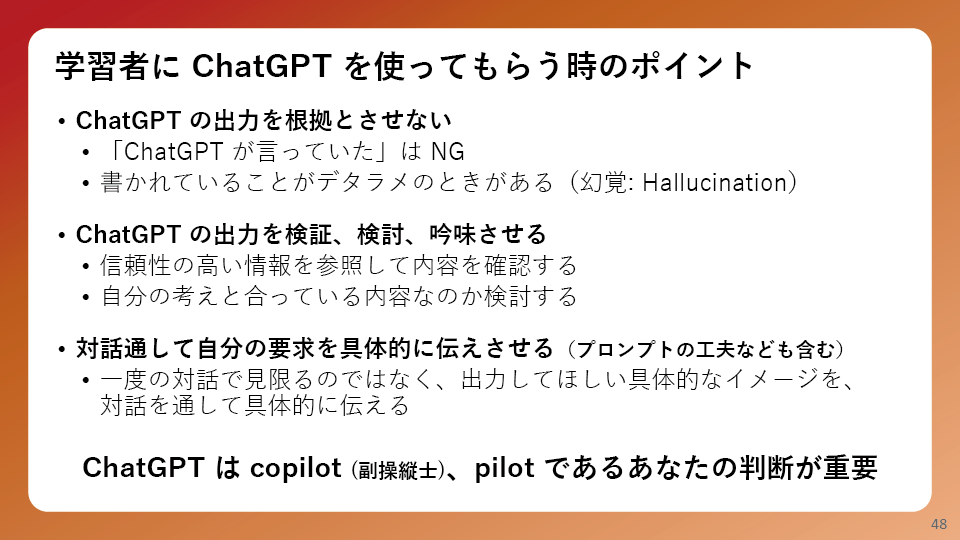

学習者に使ってもらう時のポイントとしては、やはりでたらめを言うことがあるので、基本的にChatGPTを根拠とさせないことや、ChatGPTの出力を検証、検討、吟味させることが非常に重要です。もし教員側が使うのであれば、出力を検証したうえで使うという姿勢が重要だと思います。生成系AIはcopilot(副操縦士)だということを把握しておくのがよいでしょう。メインのパイロットは利用者である人間です。出力されたものをそのまま使うのか、修正するのか、使わないのかという意思決定をしながら活用するのがよいと思っています。

▲ スライド9・ChatGPTを使う時のポイント

▲ スライド9・ChatGPTを使う時のポイント

>> 後半へ続く